IT之傢今日(7月24日),英偉達公司昨日(7 月 23 日)發佈新聞稿,正式推出“NVIDIA AI Foundry”代工服務和“NVIDIA NIM”推理微服務。

“NVIDIA AI Foundry”代工服務

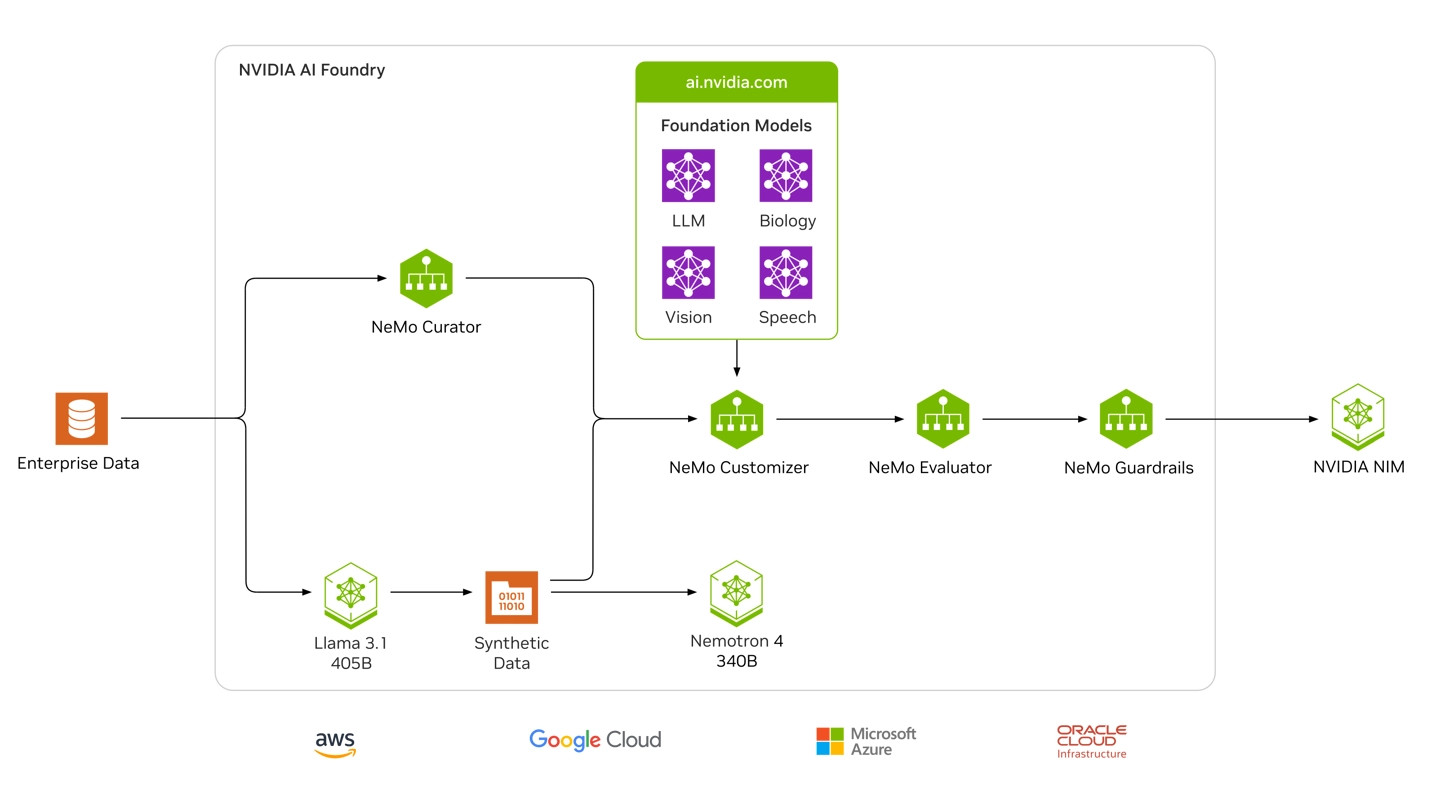

英偉達表示客戶可以使用 Meta 的 Llama 3.1 AI 模型,以及英偉達的軟件、計算和專業知識,為特定領域定制構建“超級模型”。

客戶可以利用專有數據、由 Llama 3.1 405B 和英偉達 Nemotron Reward 模型生成的合成數據來訓練這些“超級模型”。

NVIDIA AI Foundry 由 NVIDIA DGX™ Cloud AI 平臺提供支持,該平臺與世界領先的公共雲共同設計,為企業提供大量計算資源,並可根據 AI 需求的變化輕松擴展。

NVIDIA AI Foundry 包括 Nemotron 和 Edify 等英偉達創建的 AI 模型、流行的開放式基礎模型、用於定制模型的 NVIDIA NeMo™ 軟件,以及 NVIDIA DGX™ Cloud 上的專用容量(由 NVIDIA AI 專傢構建並提供支持)。

輸出結果由 NVIDIA NIM(一個推理微服務,其中包括定制模型、優化引擎和標準 API)負責,可以部署到任何地方。

NVIDIA NIM 推理微服務

NVIDIA NIM 是一套加速推理微服務,允許企業在雲計算、數據中心、工作站和 PC 等任何地方的 NVIDIA GPU 上運行AI模型。

通過使用行業標準的 API,開發人員隻需幾行代碼就能利用 NIM 部署人工智能模型。NIM 容器無縫集成 Kubernetes(K8s)生態系統,可以高效地協調和管理容器化人工智能應用。

發表評論 取消回复